Gute SEOs erkennen: Warum du Google und vielen SEO-Agenturen nicht trauen kannst

Was die SEO-Branche dir erzählt

Veröffentliche mindestens einmal pro Woche einen qualitativen Blogartikel. Publiziere nur Inhalte mit Mehrwert. Optimiere deine Texte auf das Keyword mit dem höchsten Suchvolumen. Deine Texte sollten mindestens 1.000 Wörter haben, besser noch so lang wie die der Top-3-Webseiten. Ach ja, und arbeite im Bereich SEO mit uns zusammen, denn wir sind „Google Partner“.

Falls dir diese Sätze bekannt vorkommen: Willkommen im Club. Das ist die Standardkommunikation, die ein Großteil der SEO-Branche seit Jahren reproduziert. In Blogartikeln, auf YouTube, in Verkaufsgesprächen. Zusammengefasst lautet die Botschaft: Veröffentliche viele neue Inhalte mit hoher Qualität, dann klappt das schon.

Das Problem ist nicht, dass diese Ratschläge komplett falsch sind. Das Problem ist, dass sie so unscharf formuliert sind, dass sie praktisch nichtssagend werden. Was genau ist „hochwertiger Content“ aus Sicht einer Suchmaschine? Was bedeutet „auf ein Keyword optimieren“ im Jahr 2026? Und was hat ein „Google Partner“-Badge, das für Google Ads vergeben wird, mit organischer Suchmaschinenoptimierung zu tun? Die Antwort auf die letzte Frage lautet: gar nichts.

Wer fundierte Suchmaschinenoptimierung von Phrasendrescherei unterscheiden will, braucht keine SEO-Ausbildung. Es reicht, die richtigen Fragen zu stellen. Zwei davon schauen wir uns jetzt genauer an – alternativ kannst du auch meinen Vortrag bei der IHK Lübeck dazu ansehen:

Testfrage 1: Was ist „hochwertiger Content“ aus Suchmaschinenperspektive?

Diese Frage solltest du jedem SEO-Dienstleister stellen. Nicht als Fangfrage, sondern weil die Antwort sofort zeigt, auf welchem Wissensniveau dein Gegenüber arbeitet. Wer mit „unique content“, „hohe Nutzerzufriedenheit“ oder „Inhalte mit echtem Mehrwert“ antwortet, hat die Frage nicht falsch beantwortet, aber auch nicht wirklich beantwortet. Denn die eigentliche Frage lautet ja: Was bedeutet Qualität für die Maschine, die darüber entscheidet, ob dein Inhalt gefunden wird?

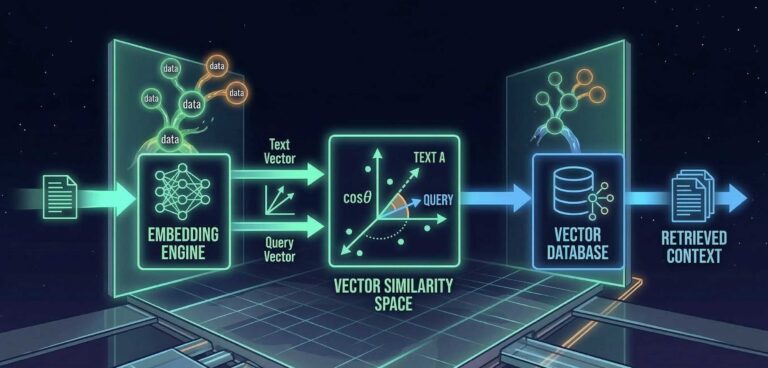

Moderne Suchmaschinen sind Information-Retrieval-Systeme. Das ist ein Teilgebiet der angewandten Informatik, das den Prozess des Auffindens und Bewertens relevanter Informationen beschreibt. Und Information Retrieval kennt keinen „Qualitätsscore“ im menschlichen Sinn. Stattdessen arbeitet es mit drei Dimensionen.

- Relevanz: Deckt sich ein Dokument inhaltlich mit der Suchanfrage? Das ist ein objektives Ja-oder-Nein-Kriterium. Entweder der Text behandelt das Thema oder er tut es nicht.

- Pertinenz: Erfüllt der Inhalt das individuelle Informationsbedürfnis des Nutzers? Das ist bereits subjektiv, denn zwei Menschen können mit derselben Suchanfrage völlig unterschiedliche Erwartungen haben.

- Nützlichkeit: Hilft der Inhalt, die beabsichtigte Aufgabe des Nutzers zu lösen? Das ist kontextuell – abhängig von Vorwissen, Situation und Ziel des Suchenden.

Content-Qualität im menschlichen Sinn, also Schreibstil, Ästhetik, persönlicher Geschmack, ist keine Dimension, die ein IR-System messen kann. Sie ist subjektiv und kontextabhängig. Was Google stattdessen messen kann und messen muss, ist Vertrauen. Und zwar nicht in einen einzelnen Text, sondern in die Summe aller Inhalte eines Autors, eines Publishers oder einer Domain innerhalb eines Themengebiets. In der SEO-Welt ist dieses System bekannt als EEAT – Experience, Expertise, Authoritativeness, Trustworthiness.

Was das konkret heißt: Google bewertet Vertrauen auf drei Ebenen. Auf Dokument-Ebene zählen Faktoren wie Originalität, Aktualität, Verweise auf seriöse Quellen, Thementiefe und -vollständigkeit. Auf Domain-Ebene spielen Technik und Rechtssicherheit, Backlinks, Domain-Alter und vor allem Themenkohärenz eine Rolle. Und auf Publisher-/Autor-Ebene fließen Netzwerke, externe Erwähnungen, Qualifikationen und Nutzersignale wie Brand Search ein.

Einen objektiv „besten“ Inhalt gibt es also nicht. Was es gibt, ist ein System, das Vertrauen auf mehreren Ebenen bewertet. Wer dir „hochwertigen Content“ verkauft, ohne erklären zu können, was das für die Maschine bedeutet, verkauft dir eine Phrase, keine Strategie.

Testfrage 2: Welche Bedeutung haben Keywords für Ihre SEO-Arbeit?

Die zweite Frage, die du deinem SEO-Dienstleister stellen solltest. Und auch hier gilt: Die Antwort ist aufschlussreicher als jede Referenzliste.

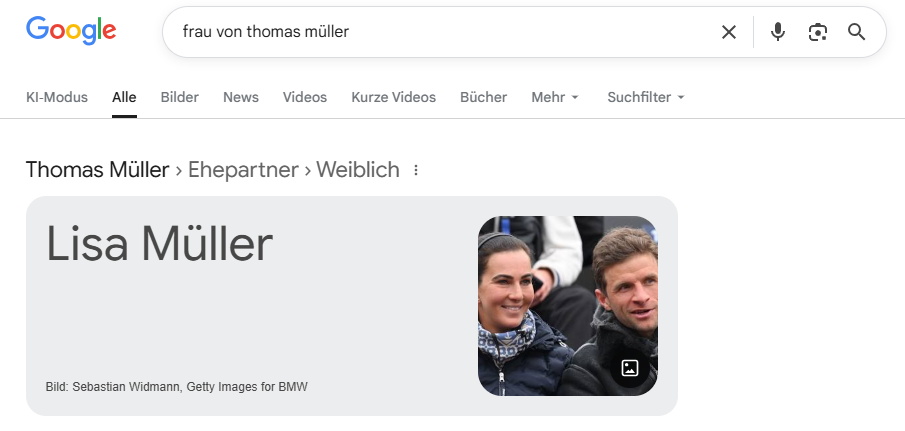

Wer auf diese Frage mit „Keyword-Dichte“, „Suchvolumen“ oder „Wir optimieren Ihre Texte auf die relevantesten Keywords“ antwortet, arbeitet auf einem technologischen Stand, den Google seit über einem Jahrzehnt hinter sich gelassen hat. Denn die Umstellung von einer rein keyword-basierten Suche hin zu einer semantischen Suche begann bei Google bereits 2012 mit der Einführung des Knowledge Graph. Seitdem versteht Google nicht nur Zeichenketten, sondern Bedeutung.

Was heißt das in der Praxis? Wenn du „fleischlose Rezepte“ googelst, zeigt dir Google vegetarische und vegane Gerichte an. Nicht weil auf diesen Seiten „fleischlos“ steht, sondern weil Google verstanden hat, dass „fleischlos“ und „vegetarisch“ dasselbe Konzept bezeichnen. Wenn du „Frau von Thomas Müller“ eingibst, zeigt Google dir Lisa Müller. Obwohl auf keiner Webseite die exakte Phrase „Frau von Thomas Müller“ als Keyword optimiert wurde. Google hat die Beziehung zwischen den Entitäten verstanden.

Das geht noch weiter. Semantische Suchmaschinen erweitern eingegebene Suchanfragen im Hintergrund um alle erdenklichen Variationen und Kombinationen. Ein Prozess namens Query Augmentation. Wer „E-Bike“ eingibt, löst bei Google nicht eine Suche aus, sondern Dutzende parallele Anfragen: E-Bike kaufen, E-Bike Typen, beste Marke E-Bike, E-Bike mit Kindern, günstiges E-Bike und so weiter. Jede dieser Teilanfragen wird gewichtet – zum Beispiel so: „E-Bike kaufen“ mit 20 %, „günstiges E-Bike“ mit 60 %, „E-Bike Mountainbike“ mit 1 %. Die Suchergebnisse, die du siehst, spiegeln diese gewichtete Interpretation wider, nicht deine ursprüngliche Eingabe.

Was folgt daraus? Keywords allein sind nutzlos. Zu jedem Keyword gehört die richtige Intention, und zu jeder Intention gehören passende Seitentypen, Layouts und Begrifflichkeiten. In der Fachsprache nennt sich das Mikrosemantik. Wenn Google bei „Autokredit“ zu 60 % eine Vergleichsabsicht erkennt, kannst du noch so viele Blogartikel schreiben – ohne der Seitentyp „Vergleichsseite“ wirst du für dieses Keyword nicht ranken. Nicht weil dein Content schlecht ist, sondern weil der Seitentyp nicht zur erkannten Absicht passt.

SEOs, die heute noch rein keyword-basiert arbeiten, „optimieren“ auf ein System, das es seit 13 Jahren in dieser Form nicht mehr gibt. Wenn dein Dienstleister dir eine Excel-Liste mit Keywords und Suchvolumen als SEO-Strategie präsentiert, ohne über Intentionen, Seitentypen und semantische Zusammenhänge zu sprechen, sollten bei dir die Alarmglocken läuten.

Woher kommt eigentlich fundiertes SEO-Wissen?

Jetzt könnte man einwenden: „Woher willst du das alles wissen? Google ist doch eine Blackbox.“ Stimmt. Und stimmt auch wieder nicht.

Korrekt ist: Google gibt keine offizielle Auskunft über Rankingfaktoren oder deren Gewichtung. Es gibt keine veröffentlichte Formel, kein Handbuch, keine Anleitung. Das ist der Grund, warum die SEO-Branche so anfällig für Spekulation und Halbwissen ist. Jeder darf sich SEO nennen, es gibt keine staatlich anerkannte Ausbildung, keinen geschützten Studiengang, keine Zertifizierung, die irgendeine Aussagekraft hätte.

Korrekt ist aber auch: Google muss sich seine Suchtechnologien patentieren lassen. Und Patente sind öffentlich zugänglich. Für jeden. Kostenlos. Auf patents.google.com.

Daraus ergibt sich eine Quellenlage, die solider ist, als die meisten SEOs wahrhaben wollen. Fundiertes SEO-Wissen stützt sich auf vier Primärquellen:

- Patente. Juristische Absicherungen innovativer Suchtechnologien. Wenn Google ein neues Ranking-Verfahren entwickelt, muss es patentiert werden. Das Patent beschreibt die Technologie im Detail, oft auf Hunderten von Seiten. Beispiel: Patent US9767157B2 zur Vorhersage von Website-Qualität.

- Research Papers. Akademische Arbeiten, peer-reviewed, in denen Google-Forscher den Einsatz neuer Technologien in der Praxis beschreiben. „Attention Is All You Need“ (2017) und das BERT-Paper (2018) sind die bekanntesten Beispiele, aber es gibt Tausende weitere.

- Leaks. Interne Google-Dokumente, die ungewollt an die Öffentlichkeit gelangen. Der spektakulärste Fall: Im Mai 2024 leakte die Content API Warehouse und offenbarte über 14.000 potenzielle Rankingfaktoren. Keine Spekulation, keine Interpretation – interner Code, der nie hätte öffentlich werden sollen.

- Gerichtsverfahren. Öffentlich zugängliche Gerichtsdokumente wie Befragungen, Beweismittel und interne E-Mails. Der US-Kartellprozess gegen Google (2023) hat eine Fülle an internen Dokumenten ans Licht gebracht, die authentischen Aufschluss über genutzte Systeme und interne Prioritäten geben.

Diese vier Quellen bilden die Evidenzbasis für professionelle Suchmaschinenoptimierung. Keine Spekulation, keine Branchengerüchte, keine Blogposts, die andere Blogposts zitieren. Wer SEO auf Basis von Patenten und Research Papers betreibt, arbeitet mit belegbaren Fakten. Wer SEO auf Basis von „Best Practices“ aus dritter Hand betreibt, arbeitet mit Hörensagen.

Muss ein guter SEO Forschungspapiere lesen wie ein Wissenschaftler und investigativ recherchieren wie ein Journalist? Kurze Antwort: Ja. Zumindest wenn er oder sie den Anspruch hat, zu verstehen, wie das System tatsächlich funktioniert, statt Maßnahmen zu wiederholen und umzusetzen, die jemand anderes aus dem Kaffeesatz gelesen hat.

Die große GEO-Abzocke

Alles, was ich in den vorherigen Abschnitten beschrieben habe – semantische Suche, Query Augmentation, die Bedeutung von Intention statt Keywords – ist kein neues Wissen. Die Technologie bzw. das Suchkonzept existiert seit Jahren. Und genau das macht den aktuellen GEO-Hype so problematisch.

Ein kurzer Rückblick. 2017 veröffentlicht Google Research das Paper „Attention Is All You Need“ – die Transformer-Architektur, die technische Basis für sämtliche heutigen Large Language Models. 2018 entwickelt Google darauf aufbauend BERT und integriert dieses Sprachmodell in die Google-Suche. Ab diesem Zeitpunkt versteht Google nicht mehr nur Wörter, sondern Sprache. 2020 veröffentlicht OpenAI auf Basis von Googles Transformer-Architektur ein Modell namens GPT-3. Und 2022 packt OpenAI diese Technologie in ein Chat-Interface und nennt es ChatGPT.

Was dann passiert, dürfte bekannt sein. Die gesamte Online-Marketing-Branche steht Kopf. SEOs behaupten, Website-Inhalte müssten „neuerdings“ für das Verständnis von LLMs optimiert werden. Ein neuer Begriff wird geboren: GEO – Generative Engine Optimization. Plötzlich bieten Agenturen, die gestern noch Keyword-Listen verkauft haben, heute GEO-Pakete an. Neues Label, neuer Preis, angeblich neue Disziplin.

Nur: Die Google-Suche arbeitet seit 2018 mit einem LLM. Wer als SEO bis 2022 nicht verstanden hat, dass Inhalte für maschinelles Sprachverständnis optimiert werden müssen, hat nicht erst seit ChatGPT ein Problem. Der hatte schon vier Jahre vorher ein Problem. Und wer diesen Rückstand jetzt als „GEO“ verpackt und als Innovation verkauft, macht aus der eigenen Wissenslücke ein Geschäftsmodell.

Ich habe das Thema in meiner Artikelreihe zur KI-Suche ausführlich aufgearbeitet. Wer die technischen Hintergründe im Detail verstehen will – wie Vektoren funktionieren, was Query Fan-out ist und warum GEO eine echte Teilmenge von SEO ist – findet dort die vollständige Herleitung: Teil 1: Was Google mit der KI-Suche zu tun hat, Teil 2: Wie KI-Suche funktioniert, Teil 3: Sichtbarkeit messen und Teil 4: Optimierung für KI-Suche.

Die Kurzversion: Alle GEO-Maßnahmen sind SEO-Maßnahmen. Wer seit 2018 semantisch sauber optimiert, macht bereits „GEO“, ohne es so zu nennen. Wer es nicht tut und jetzt GEO als separates Produkt verkauft, hat entweder die letzten sieben Jahre verschlafen oder hofft, dass du es nicht merkst.

Die richtigen Fragen stellen

Du musst kein SEO-Experte sein, um gute von schlechter Suchmaschinenoptimierung zu unterscheiden. Du musst nur wissen, welche Fragen du stellen solltest – und bei welchen Antworten du skeptisch werden darfst.

Frage: Was ist hochwertiger Content aus Suchmaschinenperspektive? Wenn die Antwort „unique content“ oder „Inhalte mit Mehrwert“ lautet, ohne zu erklären, was das für die Maschine konkret bedeutet: Warnsignal. Eine fundierte Antwort würde Information Retrieval, Relevanz, Pertinenz und das EEAT-System erwähnen.

Frage: Welche Bedeutung haben Keywords für Ihre SEO-Arbeit? Wenn die Antwort bei Keyword-Dichte und Suchvolumen endet: Warnsignal. Eine fundierte Antwort würde semantische Suche, Nutzerintentionen, Seitentypen und Query Augmentation einschließen.

Frage: Auf welchen Quellen basiert Ihre SEO-Strategie? Wenn die Antwort auf Branchenblogs, YouTube-Videos oder „eigene Erfahrung“ verweist: nachfragen. Wer professionell arbeitet, kennt die Primärquellen – Patente, Research Papers, geleakte API-Dokumentationen, Gerichtsverfahren.

Frage: Was unterscheidet Ihr GEO-Angebot von Ihrer bisherigen SEO-Arbeit? Wenn die Antwort so klingt, als handele es sich um eine völlig neue Disziplin: Vorsicht. Google setzt LLMs seit 2018 in der organischen Suche ein. Jeder SEO-Dienstleister, der semantisch optimiert, macht seit Jahren das, was heute GEO genannt wird. Wer es als separates Produkt verkauft, sollte sehr überzeugend erklären können, was daran tatsächlich neu ist.

Suchmaschinenoptimierung ist kein Geheimwissen und keine Raketenwissenschaft. Aber es ist ein Fachgebiet, das fundierte Auseinandersetzung mit den technischen Grundlagen erfordert. Die Branche hat kein Zugangsproblem – jeder darf sich SEO nennen, und genau das ist das Problem. Wer als Unternehmer oder Marketing-Entscheider Geld in SEO investiert, hat das Recht auf einen Dienstleister, der seine Empfehlungen belegen kann. Nicht mit Phrasen, nicht mit Buzzwords, sondern mit nachvollziehbaren Quellen und einem Verständnis der Technologie, die hinter der Suchmaschine steckt.

Über diesen Artikel

Die inhaltliche Verantwortung für jeden Artikel auf diesem Blog liegt bei mir, Patrick Stolp. Thema, These, Recherche und fachliche Prüfung sind meine Arbeit – hier wird nichts veröffentlicht, das ich nicht selbst konzipiert, geschrieben und als korrekt verifiziert habe. Generative KI (Claude von Anthropic) kommt punktuell als Werkzeug zum Einsatz – etwa für Formulierungsentwürfe oder das Gegenlesen technischer Erklärungen. Kein KI-Output landet ungeprüft oder unverändert auf dieser Seite. Beitragsbilder werden mit Google Nano Banana 2 erstellt.

Mehr dazu in meinen Redaktionsrichtlinien.