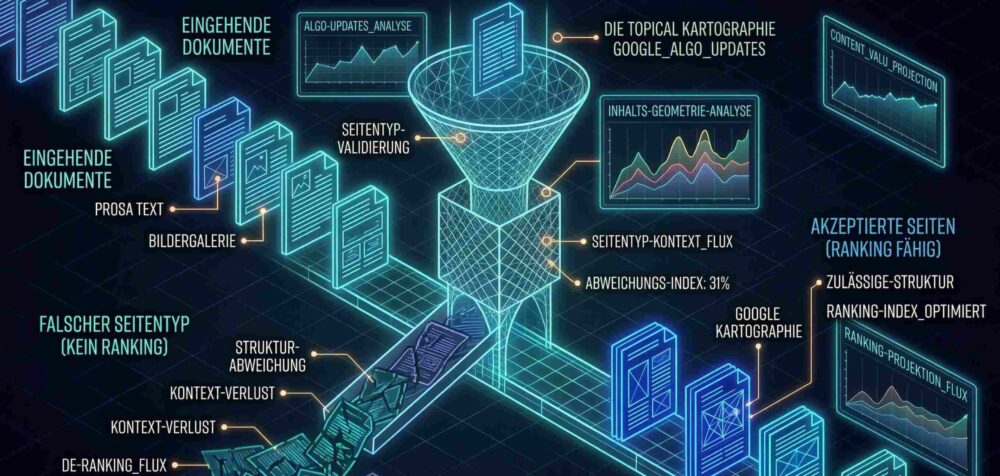

Falscher Seitentyp, kein Ranking: Warum selbst guter Content oft nicht rankt

Stell dir vor, du schreibst den besten Ratgeberartikel zum Thema Autokredit, den das deutschsprachige Internet je gesehen hat. Semantisch sauber, fachlich fundiert, saubere Heading-Hierarchie, hohe Informationsdichte, keine Füllsätze. Du hast alles richtig gemacht – zumindest nach allem, was die SEO-Branche dir erzählt.

Und trotzdem wirst du nicht auf Seite 1 erscheinen. Nicht auf Platz 3, nicht auf Platz 7, wahrscheinlich nicht mal auf Seite 2.

Der Grund hat nichts mit deinem Content zu tun. Er hat damit zu tun, dass du den falschen Seitentyp gebaut hast.

Wenn du dir die Google-Ergebnisse für „Autokredit“ anschaust, siehst du auf den vorderen Plätzen ausschließlich Vergleichsseiten. Check24, Smava, Verivox – Seiten mit Rechnern, Filtern, Zinsvergleichen. Keine davon ist ein Ratgeberartikel. Manche davon enthalten womöglich nicht einmal das Wort „Autokredit“ im Fließtext. Aber sie ranken, weil sie den Seitentyp liefern, den die Suchmaschine für diese Suchanfrage erwartet: eine Vergleichsseite mit Handlungsmöglichkeit.

Die SEO-Branche diskutiert seit Jahren über Keywords, Backlinks, Content-Länge und seit Kurzem über KI-generierte Texte. Über Seitentypen redet fast niemand – obwohl sie darüber entscheiden, ob dein Content überhaupt als Ergebniskandidat in Frage kommt. Und über Content-Formate – also die Frage, ob du für eine bestimmte Passage einen Fließtext, eine Tabelle oder eine Liste verwendest – redet noch weniger jemand, obwohl Google dafür zwei separate Scores vergibt.

Dieser Artikel erklärt, warum beides zusammenkommen muss, damit ein Dokument ranken kann. Und warum das Prinzip dahinter – wie teuer es für die Suchmaschine ist, deine Seite zu verstehen und der richtigen Absicht zuzuordnen – der eigentliche Hebel ist, den die meisten SEOs übersehen.

Suchintention ist kein Bauchgefühl

Was passiert eigentlich, wenn jemand „Autokredit“ in die Google-Suche eingibt? Die meisten SEOs würden sagen: Google schaut, welche Seiten das Keyword enthalten, bewertet Relevanz und Backlinks, und sortiert die Liste. Das ist eine Vorstellung von Suchmaschinen, die seit 2018 nicht mehr zutrifft.

Was tatsächlich passiert, ist ein mehrstufiger Klassifikationsprozess. Die Suchmaschine empfängt die Query und ordnet sie automatisch in Kategorien ein – nicht nur in die bekannten drei Typen (informational, navigational, transactional), sondern in deutlich granularere Klassen. Google nutzt dafür sogenannte Meta-Classifier, die sich aus hunderten einzelner Domain-Classifier aggregieren. Eine Query wie „Autokredit“ wird nach Domäne (Finanzen), nach Intention (Vergleich), nach erwartetem Dokumenttyp (Vergleichsseite mit Rechner oder Tabelle) und sogar danach klassifiziert, ob es sich um eine medizinisch oder finanziell sensible Anfrage handelt – also eine sogenannte YMYL-Query (Your Money, Your Life), bei der Google den Algorithmus bewusst anders gewichtet.

Wie granular diese Klassifikation ist, wurde Ende 2024 durch einen Google-Exploit sichtbar. Mark Williams-Cook und sein Team fanden einen offenen Google-Endpunkt, über den interne Daten zu über 90 Millionen Queries ausgelesen werden konnten – zwei Terabyte an Informationen, über 2.000 Properties, mit denen Google Queries und Websites klassifiziert. Google zahlte dem Team 13.337 Dollar Bug Bounty für die Meldung der Schwachstelle. Unter den Properties fanden sich acht sogenannte Refined Query Semantic Classes, in die Google nahezu jede Suchanfrage einordnet. Die größte Klasse: „Short Fact“ und „Boolean“ – Fragen, die sich mit einem Ja/Nein oder einem einzelnen Fakt beantworten lassen. Daneben existieren Klassen für komplexere Informationsabfragen, für Vergleiche, für Transaktionen. Google weiß also nicht nur, was jemand sucht – sondern welchen Antworttyp die Query erfordert.

Und genau hier kommt der Seitentyp ins Spiel. Wenn Google für „Autokredit“ ermittelt, dass die dominante Absicht ein Vergleich ist, dann erwartet die Suchmaschine einen bestimmten Dokumenttyp auf den vorderen Plätzen: eine Seite, die diesen Vergleich ermöglicht. Ein Ratgeberartikel kann fachlich perfekt sein – aber er bedient die falsche Klasse. Er antwortet auf eine Frage, die so nicht gestellt wurde.

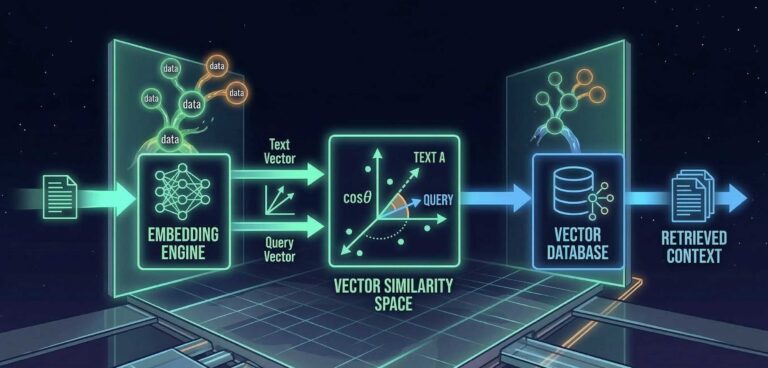

Das ist keine Spekulation. Amit Singhal – 15 Jahre lang Head of Google Search und der Mann, der Googles Ranking-Algorithmus im Jahr 2001 komplett neu geschrieben hat – hat 2003 ein Patent eingereicht, das den Mechanismus dahinter beschreibt: Das System empfängt eine Suchanfrage, baut daraus einen semantischen Kontext auf, indem es die relevantesten Dokumente analysiert, und leitet daraus einen sogenannten Semantic Concept Vector ab. Dieser Vektor bestimmt, welche verwandten Terme die Query erweitern – und welche verworfen werden. Google versteht „Autokredit“ also nicht als isoliertes Keyword, sondern als ein semantisches Feld aus Finanzierung, Zinssätzen, Laufzeiten und Anbietern. Und die Suchmaschine erwartet Seiten, die dieses Feld bedienen – nicht nur beschreiben.

Singhal hat zusammen mit Matt Cutts in einem weiteren Patent beschrieben, wie Google kommerzielle Queries identifiziert und sie bewusst anders verarbeitet als nicht-kommerzielle. Das Patent beschreibt ein System, das Suchanfragen gegen eine Liste kommerzieller Query-Muster abgleicht – unter Einbeziehung von Stemming, Synonymen und taxonomischen Zuordnungen. Wenn die Suchmaschine feststellt, dass eine Query kommerziell ist, greift eine andere Verarbeitungslogik, die andere Ergebnistypen bevorzugt. „Autokredit“ ist eindeutig kommerziell. Ein Ratgeberartikel wird in dieser Logik nicht als primärer Ergebnistyp behandelt.

Beispiel: Kommerzielle Query-Erkennung

Ein Nutzer sucht nach „günstigen Autokredit beantragen“. Das System gleicht die Query gegen eine Liste kommerzieller Muster ab – z. B. [Produkt] + beantragen, [Produkt] + kaufen, [Produkt] + Vergleich.

Dabei greift es auf drei Mechanismen zurück:

Stemming: „beantragen“ wird auf den Stamm „beantrag-“ reduziert und matcht damit auch „Beantragung“, „beantragt“ oder „Antrag“.

Synonyme: „günstig“ wird mit „billig“, „preiswert“ und „niedrige Zinsen“ abgeglichen – Varianten derselben kommerziellen Absicht.

Taxonomische Zuordnung: „Autokredit“ wird der Kategorie Finanzprodukte → Kredite → Fahrzeugfinanzierung zugeordnet. Das System erkennt: Diese Query gehört in einen kommerziellen Index – und verarbeitet sie entsprechend anders.

Die akademische Grundlage für Query-Klassifikation ist älter als Google selbst. Andrea Broder hat bereits 2002 die Taxonomie der Web-Suche definiert – informational, navigational, transactional. Jansen, Booth und Spink haben diese Klassifikation 2008 empirisch über 1,5 Millionen Queries verfeinert. Ihr Ergebnis: Über 80 % aller Queries sind informational, aber die verbleibenden 20 % – navigational und transaktional – erfordern eine fundamental andere SERP-Architektur. Für diese 20 % reicht guter Content allein nicht. Hier entscheidet der Seitentyp.

Category Constraints: Warum Google dich aussperrt

Die meisten SEOs denken beim Ranking an ein Kontinuum: Platz 1 bis 100, und irgendwo dazwischen landest du, je nachdem wie gut dein Content, deine Backlinks und deine technische Basis sind. Die Realität ist eine andere. Google arbeitet nicht nur mit einem Ranking – Google arbeitet mit Vorqualifikationen. Und wenn du die nicht erfüllst, bist du nicht auf Platz 47 statt Platz 3. Du bist gar nicht im Rennen.

Das beginnt damit, wie Google deine Website bewertet. Jede Website bekommt von Google einen sogenannten Site Quality Score – eine Zahl zwischen 0 und 1, die auf Subdomain-Ebene vergeben wird. Dieser Score basiert darauf, wie oft Nutzer gezielt nach deiner Website suchen, wie oft sie deine Seite in den Suchergebnissen anklicken – auch wenn du nicht auf Platz 1 stehst –, und wie oft dein Markenname im Anchortext von Links im Web auftaucht. Es ist im Grunde ein maschinell berechneter Markenrelevanz-Wert.

Die Daten aus dem Google-Exploit von Mark Williams-Cook zeigen, was das konkret bedeutet: Unter einem Site Quality Score von 0,4 bist du nicht berechtigt, Featured Snippets oder People-Also-Ask-Boxen zu bekommen. Es ist egal, wie perfekt dein Content für diese Formate optimiert ist – du bestehst die Vorqualifikation nicht. Williams-Cook verglich es mit Vorläufen im Sport: Es gibt Qualifikationsrennen, die du bestehen musst, bevor du überhaupt in den Endlauf kommst. Es spielt keine Rolle, was du dort drüben optimierst, wenn du nicht mal in diesem Rennen bist, weil du die Voraussetzung nicht erfüllt hast.

Aber der Site Quality Score ist nur die erste Hürde. Die zweite ist die Centerpiece Annotation – das Konzept, mit dem Google das Hauptthema und die Kategorie einer Seite bestimmt.

Im DOJ-Verfahren gegen Google wurden interne Dokumente öffentlich, die bestätigen, was SEO-Forscher wie Martin Shiblett bereits 2021 beschrieben hatten: Google analysiert den Anfangsbereich einer Webseite – die ersten ca. 400 Zeichen des gerenderten, sichtbaren Seiteninhalts –, um zu entscheiden, worum es auf dieser Seite geht und in welche Kategorie sie gehört. Wichtig: Gemeint sind nicht die ersten 400 Zeichen des HTML-Quellcodes und nicht die ersten 400 Wörter. Es sind die ersten ca. 400 Zeichen des Textinhalts, den Google nach dem Rendering der Seite sieht – also das, was auch ein Nutzer als erstes lesen würde. Ob die genaue Grenze bei 400 Zeichen, 400 Pixeln Viewport-Höhe oder einer Kombination aus beidem liegt, ist nicht abschließend dokumentiert. Klar ist: Google trifft seine Kategorisierungsentscheidung auf Basis des Anfangsbereichs – nicht auf Basis des gesamten Dokuments.

Wenn du einen Ratgeberartikel über Autokredite schreibst und dein Anfangsbereich aus einer Einleitung besteht, die erklärt, was ein Autokredit ist – dann kategorisiert Google deine Seite als informativen Content. Wenn der Anfangsbereich einer Vergleichsseite einen Darlehensrechner, Filteroptionen und einen CTA zeigt – dann kategorisiert Google diese Seite als transaktionalen, kommerziellen Content. Für die Query „Autokredit“ gewinnt die zweite Variante.

Koray Tuğberk Güler beschreibt in seinem Semantic-SEO-Framework ein Praxisbeispiel, das den Mechanismus greifbar macht: Eine Calculator-Website – eine Seite, deren Kernfunktion ein Rechner war – hatte diesen Rechner in der Mitte der Seite platziert, weil die obere Hälfte für Werbeanzeigen reserviert war. Der Rechner war also da, aber nicht im Anfangsbereich, den Google als Centerpiece analysiert. Nachdem der Rechner an den Seitenanfang verschoben wurde, wurde die gesamte Website von Google neu gecrawlt und rankte signifikant besser. Die einzige Änderung war die Platzierung. Kein neuer Content, keine neuen Links, kein Redesign. Nur die Position der Kernfunktion.

Und hier kommt das eigentlich Brutale: Selbst wenn deine Seite korrekt kategorisiert wird, kann Google sie trotzdem aussperren. Die im DOJ-Verfahren öffentlich gewordenen Dokumente zeigen, dass Google sogenannte Category Constraints anwendet – also aktiv begrenzt, wie viele Websites derselben Kategorie für eine bestimmte Query ranken dürfen. Wenn Google entscheidet, dass für eine Query maximal zwei Blogs auf Seite 1 erscheinen, wird der dritte Blog nicht angezeigt – egal wie gut sein Content ist. Die Plätze sind vergeben. Nicht weil dein Artikel schlechter ist, sondern weil das Kontingent für deine Kategorie ausgeschöpft ist.

Das erklärt, warum nach dem Helpful Content Update so viele kleine Publisher aus den SERPs verschwunden sind, während große Medienmarken blieben. Es war nicht nur eine Frage der Content-Qualität. Es war eine Frage der Kategorie-Slots: Google hat die Anzahl der Plätze für bestimmte Website-Kategorien reduziert, und wer keinen ausreichenden Site Quality Score hatte, flog zuerst raus.

Und es erklärt, warum Pandu Nayak – Googles VP of Search – öffentlich erklärt hat, dass die Verarbeitung von Queries für Google mit realen Kosten verbunden ist. Er sagte, dass Google bestimmte Long-Tail-Queries gar nicht vollständig verarbeitet, wenn die Verarbeitungskosten den Nutzen übersteigen – stattdessen wird einfach eine Seite gerankt, die bereits für die kürzere Version der Query rankt. Paul Hart, ebenfalls Google, formulierte es noch direkter: „Prove the cost is worth it.“ – Beweise, dass es sich lohnt, dich zu verarbeiten. Wenn dein Seitentyp nicht passt, deine Centerpiece Annotation falsch ist und dein Site Quality Score unter der Schwelle liegt, dann lohnt es sich für Google schlicht nicht, sich mit dir auseinanderzusetzen.

Zwei Scores, eine Seite: Warum das Format über das Ranking entscheidet

Nehmen wir an, du hast die Hürden aus dem letzten Abschnitt genommen. Dein Site Quality Score liegt über der Schwelle. Deine Seite ist korrekt kategorisiert. Du hast den richtigen Seitentyp für deine Ziel-Query. Dein Vergleichsrechner steht in den ersten 400 Zeichen. Du bist im Rennen.

Jetzt entscheidet sich, wer gewinnt. Und hier machen die meisten SEOs den nächsten Fehler – weil sie glauben, dass es ab diesem Punkt nur noch um die Qualität des Inhalts geht (was auch immer Qualität genau heißt, aber das ist ein anderes Thema). Besser recherchiert, aktueller, umfassender als die Konkurrenz. Das stimmt teilweise. Aber es fehlt ein entscheidender Faktor, der in der Branche kaum diskutiert wird: das Format, in dem du deine Antworten lieferst.

Google bewertet Textpassagen nicht mit einem einzigen Score. Es gibt zwei. Einen für strukturierten Content – Tabellen, Listen, Aufzählungen, Datenpunkte – und einen für Fließtext (Prose). Das ist keine Vermutung und kein Framework-Konzept. Es steht in einem Google-Patent von Steven de Baker – dem Mann, der Featured Snippets erfunden hat und heute an Googles AI Overviews arbeitet. Das Patent beschreibt ein System, das sogenannte Candidate Answer Passages aus Webseiten extrahiert und bewertet. Dabei werden zwei Typen von Content unterschieden: Structured Content und Unstructured Content. Für jeden Typ gelten eigene Auswahlkriterien. Das Patent sagt explizit, dass die Kombination aus beiden – Fließtext-Erklärungen plus faktische Informationen in strukturierter Form – zur höchsten Relevanz für den Nutzer führt. Die Logik dahinter: Wer nur einen Fließtext-Absatz liefert, wird nur für den Prose-Score evaluiert. Wer nur eine Tabelle liefert, nur für den Structured-Score. Wer beides auf derselben Seite kombiniert – im richtigen Kontext, am richtigen Ort –, wird für beide Scores evaluiert und hat damit einen systematischen Vorteil.

Aber es reicht nicht, einfach irgendwo eine Tabelle und irgendwo einen Absatz einzufügen. Ein zweites Patent von de Bakers Team beschreibt, wie der Score einer einzelnen Passage nachträglich angepasst wird – und die Kriterien dafür sind präzise:

| Scoring-Faktor | Was Google misst | Konsequenz |

|---|---|---|

| Heading Vector Depth | Wie tief in der Heading-Hierarchie die Antwort steht | Antwort unter H3 wird höher bewertet als unter H1 – entgegen der Branchenannahme |

| Passage Coverage Ratio | Verhältnis von Antwort zu Fülltext innerhalb einer Passage | Mehr Fülltext = niedrigerer Score. Einleitungssätze, Übergänge und Wiederholungen schaden messbar |

| Preceding Questions | Ob eine Frage der Antwortpassage direkt vorangeht | Weniger Textdistanz zwischen Frage und Antwort = höherer Bonus |

| Distinctive Text | Ob Text fett oder visuell hervorgehoben ist | Hervorgehobener Text wird als Antwortkandidat bevorzugt |

Alle vier Faktoren beschreibt de Bakers Patent über Context Scoring Adjustments for Answer Passages. Google hat 2021 mit Passage Ranking eine Technologie eingeführt, die es ermöglicht, einzelne Textpassagen unabhängig vom Gesamtdokument zu ranken. Ein Patent desselben Umfelds beschreibt, wie ein neuronales Netzwerk eigenständige Text-Spans identifiziert und bewertet. Zusammen ergibt sich ein Bild, das die meisten Content-Strategien grundsätzlich in Frage stellt: Jeder Absatz, jede Tabelle, jede Liste auf deiner Website ist ein eigenständiger Antwortkandidat mit eigenem Score. Nicht deine Seite konkurriert – deine Passagen konkurrieren.

Und das hat eine direkte Konsequenz, die Koray in seinem Framework als eine der wichtigsten Regeln beschreibt: Beantworte dieselbe Frage nicht auf mehreren Seiten im selben Format. Wenn du einen Artikel über Hypothekentypen hast und dort alle Typen als ausführliche Liste aufführst – gut. Aber wenn du auf deiner Statistik-Seite die gleiche Frage mit der gleichen Liste beantwortest, konkurrieren deine eigenen Passagen gegeneinander. Die Suchmaschine muss entscheiden, welche Version sie rankt, und in diesem Entscheidungsprozess verlieren oft beide.

Die Regel lautet: Das richtige Format gehört auf die richtige Seite. Die Seite, deren Macro Context – also das Hauptthema, definiert durch Title Tag, H1 und den überwiegenden Teil der Heading-Hierarchie – die Frage abdeckt, bekommt das vollständige, korrekte Antwortformat. Alle anderen Seiten, die dieselbe Frage im Supplementary Content streifen, beantworten sie in einem anderen Format oder kürzer. Nicht weil die Information dort weniger wichtig wäre – sondern weil du ein eindeutiges Signal setzen musst, welche Seite deiner Website die autoritative Antwort für diese Frage liefert.

Cost of Retrieval: Das Prinzip hinter allem

Seitentypen, Category Constraints, Centerpiece Annotation, Structured und Prose Scores, Passage Coverage Ratio – das sind viele Einzelmechanismen. Aber sie folgen alle derselben Logik. Und diese Logik lässt sich in einem einzigen Satz zusammenfassen: Google rankt dich so hoch wie die Differenz zwischen deiner Qualität und deinen Kosten.

Kosten bedeutet hier nicht Geld. Es bedeutet Rechenaufwand. Jede Seite, die Google crawlt, indiziert, rendert, parst und bewertet, verbraucht Ressourcen. Serverkapazität, Speicher, Rechenzeit. Bei Milliarden von Webseiten summiert sich das. Und Google ist – bei aller technologischen Überlegenheit – ein Unternehmen, das wirtschaftlich arbeitet. Wenn deine Seite mehr kostet als sie bringt, wird sie nicht bevorzugt behandelt. Nicht aus Bosheit, sondern aus Effizienz.

Koray Tuğberk Güler hat dieses Prinzip als Cost of Retrieval formalisiert und beschreibt es als das Fundament seines gesamten Topical-Authority-Frameworks. Von Koray stammt auch die Regel: „Cost of ranking a website cannot be higher than cost of not ranking the website.“ Die Kosten, dich zu ranken, dürfen nicht höher sein als die Kosten, dich nicht zu ranken – also die Kosten, die Google entstehen, wenn sie stattdessen eine schlechtere Antwort auf der SERP haben.

Genau hier verbinden sich alle Mechanismen, die dieser Artikel beschrieben hat:

- Wenn dein Seitentyp falsch ist, muss Google mehr Aufwand betreiben, um zu verstehen, warum deine Seite nicht zur Query passt – und verwirft sie. Die Kosten der Fehlzuordnung sind höher als der Nutzen deines Contents.

- Wenn deine Centerpiece Annotation nicht stimmt – weil deine Kernfunktion nicht im Anfangsbereich steht –, muss Google die gesamte Seite parsen, um herauszufinden, worum es eigentlich geht. Eine Seite, die ihre Kategorie sofort signalisiert, ist billiger zu verarbeiten. Die billigere Seite gewinnt.

- Wenn dein Content-Format ineffizient ist – nur Fließtext, keine Tabelle, keine strukturierten Datenpunkte –, kann Google nur den Prose-Score berechnen. Für den Structured-Score fehlt die Grundlage. Eine Seite, die beide Scores liefert, gibt Google mehr Bewertungssignale bei gleichem Verarbeitungsaufwand.

- Wenn du dieselbe Frage auf fünf Seiten im selben Format beantwortest, muss Google für jede dieser Passagen einen eigenen Scoring-Durchlauf machen und entscheiden, welche die autoritative Antwort ist. Das ist fünfmal so teuer wie einmal. Die Seite, die das richtige Format am richtigen Ort hat – einmal, eindeutig –, senkt Googles Entscheidungskosten auf ein Minimum.

Luis Salazar, einer der erfolgreichsten Praktiker von Korays Framework, fasst es im Interview mit Koray so zusammen: „Cost is everything at all levels in all fronts – in semantics, in JavaScript, CSS, HTML, image sizes – everything.“ Und er fügt hinzu, dass JSON-LD – also strukturierte Daten im maschinenlesbaren Format – der billigste Weg ist, Google mitzuteilen, worum es auf deiner Seite geht. Kein Rendering nötig, kein HTML-Parsing. Der Bot kommt, liest das JSON-LD, und geht. Minimaler Speicherverbrauch, minimale Verarbeitungskosten.

Cost of Retrieval ist kein einzelnes Patent und kein einzelner Algorithmus. Es ist das übergreifende ökonomische Prinzip, das erklärt, warum Google all diese Mechanismen einsetzt – und warum sie in der Summe darüber entscheiden, ob dein Content sichtbar wird oder nicht.

Die vier Fragen, die du dir stellen solltest

Du musst kein Experte für Google-Patente sein, um die Konzepte aus diesem Artikel in der Praxis anzuwenden. Du musst nur bereit sein, vier Fragen ehrlich zu beantworten, bevor du den nächsten Artikel veröffentlichst oder die nächste Landingpage baust.

Welchen Seitentyp erwartet die Suchmaschine für meine Ziel-Query?

Öffne ein Inkognito-Fenster und gib deine Query ein. Schau dir nicht die Inhalte an – schau dir die Seitentypen an. Sind es Vergleichsseiten mit Rechnern? Produktlisten mit Filtern? Ratgeberartikel mit Inhaltsverzeichnis? Foren mit Nutzermeinungen? Wenn auf den ersten zehn Plätzen ausschließlich Vergleichsseiten stehen und du einen Ratgeber gebaut hast, ist das kein Ranking-Problem. Es ist ein Kategorie-Problem. Du bist nicht im falschen Rennen schlecht platziert – du bist in einem anderen Rennen.

Steht deine Kernfunktion im Anfangsbereich der Seite?

Wenn du eine Vergleichsseite baust, aber dein Vergleichsrechner erst nach drei Absätzen Einleitungstext kommt – dann sieht Google in der Centerpiece Annotation einen Ratgeberartikel, keine Vergleichsseite. Deine Kategorisierung stimmt nicht mit deiner Absicht überein. Das Gleiche gilt für Produktseiten, auf denen das Produkt erst nach einer langen Markengeschichte erscheint. Oder für Tool-Seiten, auf denen das Tool hinter einem Cookie-Banner und zwei Werbeblöcken versteckt ist. Was Google im gerenderten Anfangsbereich deiner Seite sieht, bestimmt, was Google glaubt, dass deine Seite ist.

Nutzt du beide Format-Scores?

Wenn deine Seite ausschließlich aus Fließtext besteht – kein Vergleich in Tabellenform, keine strukturierte Liste, keine nummerierten Schritte –, wirst du nur für den Prose-Score evaluiert. Den Structured-Score verschenkst du. Und dein Wettbewerber, der eine Tabelle unter seiner H3 hat, bekommt beide. Das bedeutet nicht, dass du wahllos Tabellen einstreuen sollst. Es bedeutet, dass du für jede Passage bewusst entscheiden musst: Welches Format transportiert diese Information am besten – und erhöht gleichzeitig meinen Score?

| Informationstyp | Empfohlenes Format | Score-Typ |

|---|---|---|

| Gegenüberstellung von Konditionen, Produkten, Anbietern | Tabelle | Structured |

| Schritt-für-Schritt-Anleitung, Prozessbeschreibung | Nummerierte Liste | Structured |

| Aufzählung von Merkmalen, Vorteilen, Kriterien | Bullet-Point-Liste | Structured |

| Einordnung, Bewertung, Erklärung eines Zusammenhangs | Fließtext-Absatz | Prose |

| Definition eines Fachbegriffs | Fließtext, direkt unter der Frage-Überschrift | Prose (+ Preceding Question Bonus) |

Beantwortest du dieselbe Frage auf mehreren Seiten im selben Format?

Wenn dein Hypotheken-Ratgeber alle Hypothekentypen als ausführliche Liste aufführt und deine Hypotheken-Statistik-Seite dieselbe Liste enthält – dann konkurrierst du gegen dich selbst. Google muss entscheiden, welche deiner eigenen Passagen die autoritative Antwort ist. In diesem Entscheidungsprozess verlieren häufig beide. Die Regel: Das vollständige Antwortformat gehört auf die Seite, deren Macro Context die Frage abdeckt. Überall sonst wird gekürzt, ein anderes Format gewählt oder nur angerissen.

Seitentypen und Content-Formate sind keine Randthemen für technische SEOs. Sie sind die Voraussetzungen dafür, dass dein Content überhaupt als Kandidat in Betracht gezogen wird. Wer sie ignoriert, kann alles andere richtig machen – Topical Authority, semantische Suche, interne Verlinkung, Backlinks – und trotzdem an einer Schwelle scheitern, die er nie gesehen hat. Wer sie versteht, trifft bessere Entscheidungen. Nicht über Keywords. Über Architektur.